Pertinente pensar en abordar regulación en forma regional.

Partir de un amplio y profundo diagnóstico, elaborar una especie de evaluación de impacto para establecer criterios regionales, sandboxes regulatorios, no delegar a particulares la garantía de derechos, así como mapear debidamente los objetivos que se buscan alcanzar, son algunos de los planteamientos recomendados por especialistas, antes de fijar cualquier regulación de contenidos en plataformas sociales.

Al inaugurar los diálogos nacionales “Moderación de contenidos y la libertad de expresión en redes sociales”, Frédéric Vacheron, representante de la Unesco en México, reconoció la complejidad de este debate, por su alcance multidimensional y porque podría afectar a decenas de miles de personas en otras latitudes.

“Se trata de un reto complejo y multidimensional, pero estamos en el momento clave para establecer líneas de bases para plantear soluciones claras para la buena gobernanza de las plataformas sociales”, advirtió.

Al participar en la Mesa “Alcance de la Moderación”, Adriana Labardini, abogada especialista en regulación y competencia, advirtió la necesidad de mapear a dónde se quiere llegar, así como priorizar cuál conducta se quiere proteger o a quién proteger, y entonces sí hablar de una regulación, sus alcances y de si regulamos, no contenido sino más bien un proceso.

Tenemos que mapear, luego ver en el contexto mexicano qué norma jurídica ya está cubriendo esa conducta antisocial en línea o fuera de línea, porque, dijo, “no podemos tener más derechos si estamos en un ambiente en línea o menos derechos si estamos fuera de línea”.

“Hay que hacer un mapa mexicano, que incluya mejores prácticas, derecho comparado, experiencias internacionales. Después, si puede regionalizarse o globalizarse”. Además, subrayó, es necesario conocer muy bien el estado actual del ecosistema de la economía de datos, pues todo está incentivado por una monetización.

La especialista consideró que hay muchas herramientas y se pueden usar a través de una estrategia, como está haciendo el Reino Unido, donde se coordinan trabajos de competencia, autoridades en materia de privacidad y autoridad reguladora de telecomunicaciones para lograr la tutela y la co-tutela, porque “no se vale nada más delegarle a los particulares la garantía de estos derechos humanos”.

Raúl Echeberría, de la Asociación Latinoamericana de Internet (ALAI), coincidió en las propuestas de la especialista y criticó que se parta de la base de que la regulación es necesaria, sin explorar primero cuáles son los objetivos, qué es lo que se pretende lograr y cuáles son los mejores instrumentos.

Además, regulaciones aisladas, es decir, países en lo individual, no tienen sentido, así como tampoco instrumentar normas de otras regiones como las de Europa, donde prevalece una realidad distinta y mecanismos de regulación transnacionales que “no tenemos, así como tampoco el poder que ellos tienen a través de los instrumentos de enforcement”.

Si bien pueden existir modelos de regulación basados en buenas prácticas o que obligan a la transparencia, hay que buscar enfoques innovadores, como usar sandboxes regulatorios para medir los efectos, hacer ejercicios y simulaciones y medir los impactos.

En el encuentro virtual organizado por la Unesco y Observacom, Javier Juárez, comisionado del IFT cuestionó la viabilidad de las autorizaciones para redes sociales que se plantean en México, pues ello les daría un nivel de prestadores de servicios de telecomunicaciones, y ¿cómo se lograría el enforcement?, cuando los intermediarios no tienen infraestructura en territorio nacional.

¿Qué pasa si uno de los operadores de redes sociales no viene por esa autorización, ¿Cómo hacer valer una regulación como la que se propone en México? expuso el comisionado del Instituto Federal de Telecomunicaciones (IFT), para quien el tema debe verse de manera global y no aislada como país.

Manuel Larrondo, abogado y docente en la Facultad de Periodismo y Comunicación Social de la Universidad Nacional de la Plata, de Buenos Aires, Argentina, planteó una suerte de “análisis de principios precautorio algorítmico” para en caso de que una plataforma quiera operar en cierta región.

De esta manera, en Sudamérica, por ejemplo, el discurso de odio ¿cómo se interpretaría?, ¿Los términos y condiciones son adecuados?. Pensar como cuando una empresa va a instalar una fábrica y se le pide una evaluación de impacto ambiental, en el caso de las redes sería un impacto algorítmico.

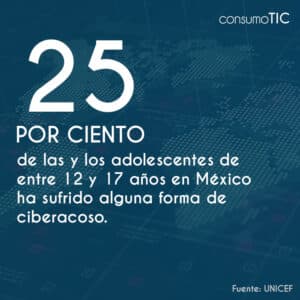

En su participación, la investigadora Dorismilda Flores Márquez, especializada en comunicación y cultura digital, subrayó la necesidad de un equilibrio entre proteger la privacidad de los usuarios de Internet y la capacidad de que se regulen algunas acciones o algunas conductas que quedan claramente fuera de la ley.

Por ejemplo, los casos de violencia digital y una serie de situaciones que ocurren en las plataformas, las cuales cuentan con elementos para detectarse, pero los reportes no ocurren o no se les da seguimiento.

C$T-EVP